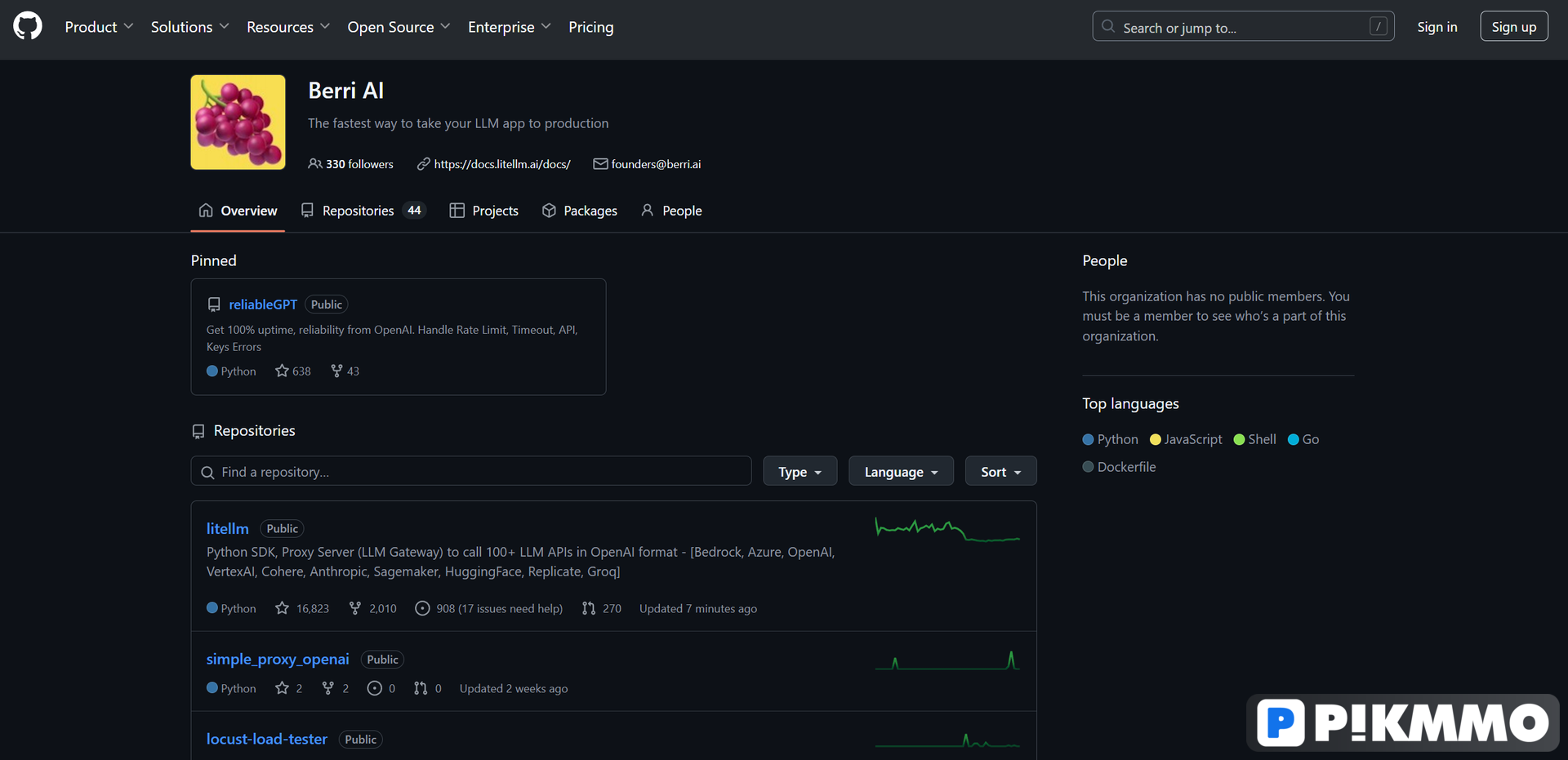

BerriAI-litellm – Giải pháp toàn diện cho tích hợp trí tuệ nhân tạo

BerriAI-litellm là công cụ đột phá trong việc tương tác với các mô hình ngôn ngữ lớn (LLMs) bằng cách cung cấp một SDK Python và Máy chủ Proxy, được thiết kế để tích hợp mượt mà với hơn 100 API LLM trong định dạng OpenAI. Công cụ độc đáo này được tùy chỉnh cho các nhà phát triển và doanh nghiệp mong muốn tối ưu hóa quy trình gọi nhiều API LLM đa dạng như Bedrock, Azure, OpenAI, VertexAI, và nhiều hơn nữa. Bằng cách đơn giản hóa việc tích hợp và quản lý nhiều LLM khác nhau, BerriAI-litellm giải quyết các khó khăn liên quan đến việc quản lý và dịch gọi giữa các nền tảng AI khác nhau.

Điểm nổi bật:

- Tích hợp LLM toàn diện: Hỗ trợ hơn 100 API LLM, cho phép người dùng truy cập vào nhiều mô hình từ các nhà cung cấp như HuggingFace, Cohere, và Anthropic.

- Định dạng đầu ra nhất quán: Đảm bảo đầu ra thống nhất bằng cách tuân thủ định dạng OpenAI, đơn giản hóa quá trình tích hợp trên các mô hình khác nhau.

- Logic thử lại và dự phòng: Cung cấp cơ chế mạnh mẽ cho việc thử lại và dự phòng trên nhiều triển khai, nâng cao độ tin cậy và hiệu suất.

- Quản lý ngân sách và giới hạn tốc độ: Cho phép người dùng thiết lập ngân sách và giới hạn tốc độ cho mỗi dự án, khóa API, hoặc mô hình, cung cấp kiểm soát chính xác về việc sử dụng tài nguyên.

BerriAI-litellm là công cụ không thể thiếu cho các nhà phát triển và doanh nghiệp muốn tích hợp và quản lý nhiều API LLM một cách hiệu quả. Với các tính năng mạnh mẽ và giao diện thân thiện với người dùng, nó giúp đơn giản hóa các khía cạnh phức tạp của quản lý mô hình AI, trở thành một tài nguyên quý giá cho bất kỳ ai tham gia vào phát triển và nghiên cứu AI.